6月30日,百度正式开源文心大模型4.5系列模型,涵盖47B、3B激活参数的混合专家(MoE)模型,与0.3B参数的稠密型模型等10款模型,并实现预训练权重和推理代码的完全开源。目前,文心大模型4.5开源系列可在飞桨星河社区、HuggingFace等平台下载部署使用,同时开源模型API服务也可在百度智能云千帆大模型平台使用。(一财科技)

举报 第一财经广告合作,请点击这里此内容为第一财经原创,著作权归第一财经所有。未经第一财经书面授权,不得以任何方式加以使用,包括转载、摘编、复制或建立镜像。第一财经保留追究侵权者法律责任的权利。如需获得授权请联系第一财经版权部:banquan@yicai.com 文章作者

一财科技

相关阅读 盘古团队最新声明:严格遵循开源要求

盘古团队最新声明:严格遵循开源要求 华为诺亚方舟实验室在官方平台发布最新声明,表示盘古Pro MoE开源模型是基于昇腾硬件平台开发、训练的基础大模型,并非基于其他厂商模型增量训练而来。

63 07-05 17:14 大模型如何发展这条路,任正非李彦宏都想“开”了

大模型如何发展这条路,任正非李彦宏都想“开”了集体开源行动背后,既是对AI进入应用为王时代的回应,也有各家加速抢占市场高地、应对国际竞争的战略布局。

11 792 06-30 18:34 华为宣布开源盘古7B稠密和72B混合专家模型

华为宣布开源盘古7B稠密和72B混合专家模型盘古7B相关模型权重与推理代码将于近期上线开源平台。

146 06-30 08:53 AI进化速递丨腾讯混元首款开源混合推理MoE模型发布

AI进化速递丨腾讯混元首款开源混合推理MoE模型发布腾讯混元首款开源混合推理MoE模型 「Hunyuan-A13B」发布。

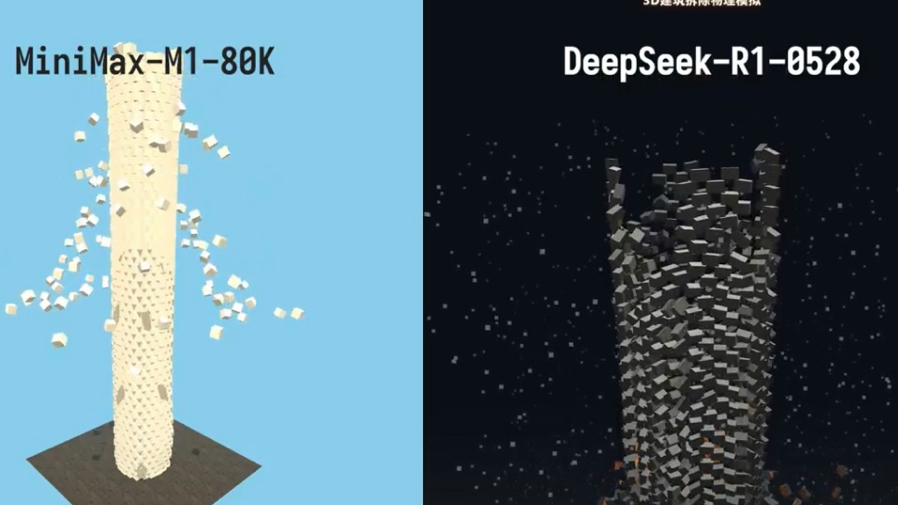

95 06-27 20:38 MiniMax发布推理模型对标DeepSeek,算力成本仅约53万美元

MiniMax发布推理模型对标DeepSeek,算力成本仅约53万美元官方直接对标DeepSeek喊话“性价比更高”。

6 128 06-17 15:01 一财最热 点击关闭